Imagen de la serie Black Mirror en la que se crea una réplica robótica de una persona fallecida

Ciencia

La IA se encuentra a punto de simular la personalidad de una persona fallecida: «Se juega con el dolor de las personas»

En un reciente artículo se presentan las posibles implementaciones de los fantasmas generativos, así como sus posibles impactos

Actualmente, empresas como Re;memory o HereAfter AI permite grabar horas o crear versiones digitales a partir de conversaciones previas

El arte de 'revivir' o la resurrección de una persona siempre ha sido un fenómeno más asociado a la ciencia ficción que a la propia realidad actual. Uno de los últimos ejemplos lo pudimos ver en la serie Black Mirror. Durante los 49 minutos que dura el capítulo Ahora mismo vuelvo, la serie coquetea con la idea de que la inteligencia artificial y la robótica puedan suplantar el cuerpo y la personalidad de una persona fallecida. Ahora, 12 años después de la emisión de este capítulo, la ciencia ya ha establecido un nombre para definir esta sustitución: fantasmas generativos.

Este término, acuñado en un reciente artículo científico realizado por Meredith Ringel Morris —de la empresa Google Deepmind—, destaca la influencia de la inteligencia artificial como un software que podría llegar a sustituir a las emociones humanas.

«Prevemos que, durante nuestra vida, la creación de agentes de IA personalizados para interactuar con seres queridos o con el mundo después de la muerte podría convertirse en una práctica común; de hecho, el último año ha presenciado un auge de startups que pretenden ofrecer estos servicios», detalla el artículo publicado en ArXiv. La investigación presenta un espacio de posibles implementaciones de estos fantasmas generativos, así como los posibles impactos positivos y negativos en la sociedad.

Imagen de la serie Black Mirror en la que se 'revive' a una persona fallecida

«Lo que se está haciendo en este sentido con estos algoritmos de inteligencia artificial es enseñar a la máquina virtual, al modelo de inteligencia artificial, y puedes enseñar con los datos que a ti te parezcan igualmente y puedes personalizarlo con los datos», señala a El Debate Idoia Salazar, cofundadora y presidenta del Observatorio del Impacto Social y Ético de la Inteligencia Artificial, OdiseIA.

En concreto, tal como señala el estudio de Google, estos fantasmas generativos de inteligencia artificial están diseñados para representar digitalmente a personas fallecidas, no solo replicando contenido ya creado, sino generando nuevas respuestas y comportamientos en línea con la personalidad del representado. Por lo tanto, a medida que los modelos generativos y multimodales avanzan, la idea de que alguien pueda «seguir existiendo» como una IA tras su muerte se vuelve más viable.

El artículo expone diversos beneficios que los fantasmas generativos podrían aportar. Para la persona representada, pueden ser una herramienta para preservar memorias, transmitir valores o incluso participar en la economía digital tras su muerte. Para los deudos, ofrecen consuelo emocional, continuidad simbólica y acceso práctico a recuerdos o conocimientos.

En en en el mundo occidental no tiene mucho sentido y hacen daño al propio dueloCofundadora y presidenta del Observatorio del Impacto Social y Ético de la Inteligencia Artificial, OdiseIA

A nivel social, estos agentes podrían ser vehículos para preservar culturas, lenguas en riesgo y voces históricas. Se exploran también usos educativos, religiosos, archivísticos y legales, donde los fantasmas generativos podrían tener un rol activo en la transmisión de saberes o en procesos legales post-mortem. La interactividad y fidelidad de estos sistemas les otorgan un potencial superior al de simples memoriales digitales o perfiles conmemorativos.

De hecho, el concepto de fantasma generativo no es realmente ya nuevo. Ya hace años, empresas como Microsoft pusieron en marcha sistemas de software prácticamente calcados al descrito actualmente. La diferencia es que, en aquel entonces, Microsoft dejó esta nueva y peligrosa tecnología en un segundo plano, dado las duras connotaciones éticas que conllevaba.

«Al final estás personificando un algoritmo de inteligencia artificial, que es un software que es algo inanimado, que hay una empresa detrás. Microsoft dejó de hacerlo, pero hubo bastantes otras empresas que siguieron con estos modelos descriptivos. Al final es un negocio. En este caso se está jugando con el dolor de las personas», describe la especialista en Ética e Inteligencia Artificial, quien además es Profesora Doctora en la Universidad CEU San Pablo.

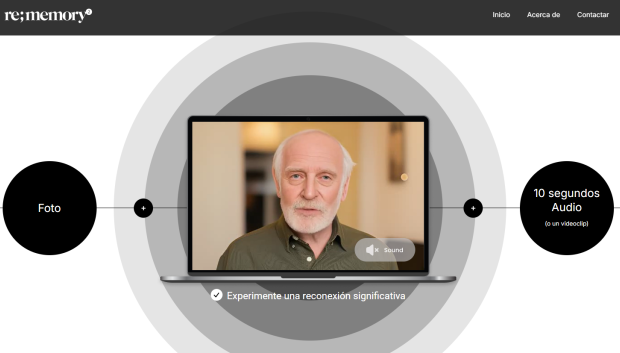

Ejemplo de creación de avatar en la web Re;memory

De hecho, a día de hoy ya hay varias empresas que han puesto estos fantasmas generativos en práctica. La empresa Re;memory permite grabar horas de entrevistas para construir una IA que hable y comparta anécdotas. Por su parte, HereAfter AI, crea versiones digitales a partir de conversaciones que ya han tenido lugar.

Riesgos y connotaciones éticas

Como es lógico, este tipo de prácticas tiene una serie de múltiples peligros. Desde el punto de vista de la salud mental, existe el peligro de que interfieran con el proceso natural del duelo, fomenten la dependencia emocional, o provoquen fenómenos de «segunda muerte» si el acceso a la IA se pierde repentinamente.

Asimismo, tal como han detallado distintos expertos y psicólogos, este tipo de tecnologías y prácticas pueden llegar a afectar al duelo de una persona cuyo familiar ha fallecido. Por ello, en los últimos años se ha puesto en marcha una campaña de concienciación acerca de los peligros para salud mental de los familiares y allegados. De igual manera, la experta destaca la gran dependencia emocional que podría suponer, sobre todo en otras zonas del mundo donde no se vive el duelo de la misma manera que en Occidente. Por ejemplo en lugares como China o Corea del Sur, donde los lazos con los ancestros son parte de la cultura, este tipo de tecnologías son más socialmente aceptadas.

«A lo mejor en Asia o en otro lugar, pues sí se lleva mejor, porque allí incluso se casan con los algoritmos de IA en el mundo asiático. Y no pasa nada. Pero desde luego aquí no. En el mundo occidental no tiene mucho sentido y hacen daño al propio duelo que tiene que seguir teniendo el ser humano cuando pierde a un ser querido», señala Salazar.

Finalmente, ante el posible riesgo de una posible utilización de la inteligencia artificial para suplantar al 100 % la personalidad, la manera de pensar y las emociones de un fallecido, la experta espera que ese futuro «no llegue ni a pasar».